AI对于生物学,早就不只是AlphaFold了

“21世纪是生命科学的世纪”,不知道曾经是谁提出了这个概念。

从这几年的势头看起来,21世纪,应该也是人工智能(AI)的世纪。前脚是2016年会下围棋的AlphaGO,后脚是2021年震惊结构生物学的AlphaFold2,再到如今可能影响数十亿人工作和生活的ChatGPT。

AI,已经开始创造各种新的历史了。

这几年最火的几个AI(左图为AlphaGO纪录片海报,右上图为AlphaFold预测完全部序列蛋白质结构的数据库,右下图是OpenAI官网对ChatGPT的介绍)

而这其中,对生命科学震撼最大的要属当然是前两年的AlphaFold2:超高准确度的蛋白质结构预测能力,几乎完全改写了结构生物学的研究方式,也让相关的生物学研究更加便利。

但是,你要是以为生命科学里的AI只有AlphaFold,那你就大错特错了。

从预测到创造,AI要颠覆蛋白质世界!

不过要展开聊生命科学里的AI,蛋白质结构预测还是绕不过去的话题。

自从2021年DeepMind公司推出了AlphaFold2,和华盛顿大学开发出的RoseTTAFold这两项充满代表性的蛋白质预测工具之后,这个领域就变得一发不可收拾了。

首先是持续发力的AlphaFold2。

正式发布后只过了半年多,2022年7月,DeepMind公司的CEO,杰米斯·哈萨比斯 (Demis Hassabis)就在新闻发布会宣布:我们已经掌握了“整个蛋白质世界”(The entire protein universe)——AlphaFold马不停蹄地运转,成功完成了现有蛋白质数据库中全部2.14亿种蛋白质的结构预测。

DeepMind公司CEO,杰米斯·哈萨比斯 (Demis Hassabis) | 图源:Jung Yeon-Je/AFP/Getty

2.14亿种蛋白质中,有35%被评估为高度准确,虽然这个数字看起来不高,但是按照目前实验检测的水平,全部做完也就差不多这个水平——更何况,截至目前实验检测花了几十年也只测出了14万种。

这些蛋白质结构,也已经发布在AlphaFold和欧洲生物信息学研究所 (EMBL-EBI)建立的数据库中,供科研工作者们使用(https://alphafold.ebi.ac.uk/,前文图)。

但这也只是AI在蛋白质领域发力的开始。

我们知道,蛋白质是由DNA转录、翻译形成的,而DNA测序也远比蛋白质测序更加快速、价格更低。因此,DNA数据库的数据量远比蛋白质数据库多。这多出来的,很关键的一部分,叫做宏基因组(Metagenome)。

在过去几年,科学家们从野外等特殊环境,比如土壤、海洋、肠道等等,直接通过测序得到了成千上万种未知,且无法培养的微生物DNA信息,也就是所谓的宏基因组。

宏基因组产生的过程 | 图源:Wooley JC, 2010.

仅在DeepMind公司宣布完成了“整个蛋白质世界”三个月后,2022年10月,Meta公司(原名Facebook)就拓宽了这个“蛋白质世界”的边界(‘dark matter’ of the protein universe)——他们利用自己开发的大型语言模型算法ESMFold,预测了6.17亿种来自宏基因组信息的微生物蛋白质结构。

ESMFold算法的准确度虽然略逊于AlphaFold,但它的优势在于能以60倍于AlphaFold的速度去预测短序列蛋白质的结构,这就使得它在预测结构相对简单的微生物蛋白质上有了很大的优势。

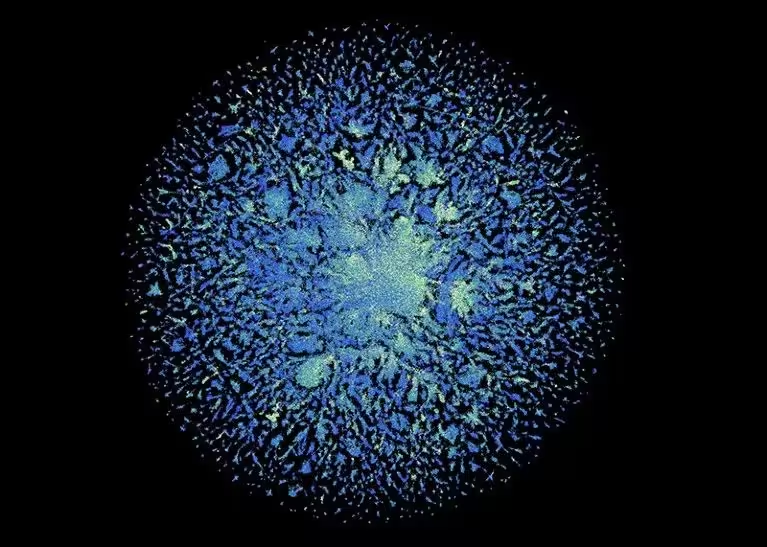

6.17亿种蛋白质结构的全览 | 图源:ESM Metagenomic Atlas

这让人不禁好奇,差不多全预测完之后,AI下一步会在蛋白质结构上做些什么?没过几天,AI又开始颠覆生物学家的认知了——创造蛋白质。

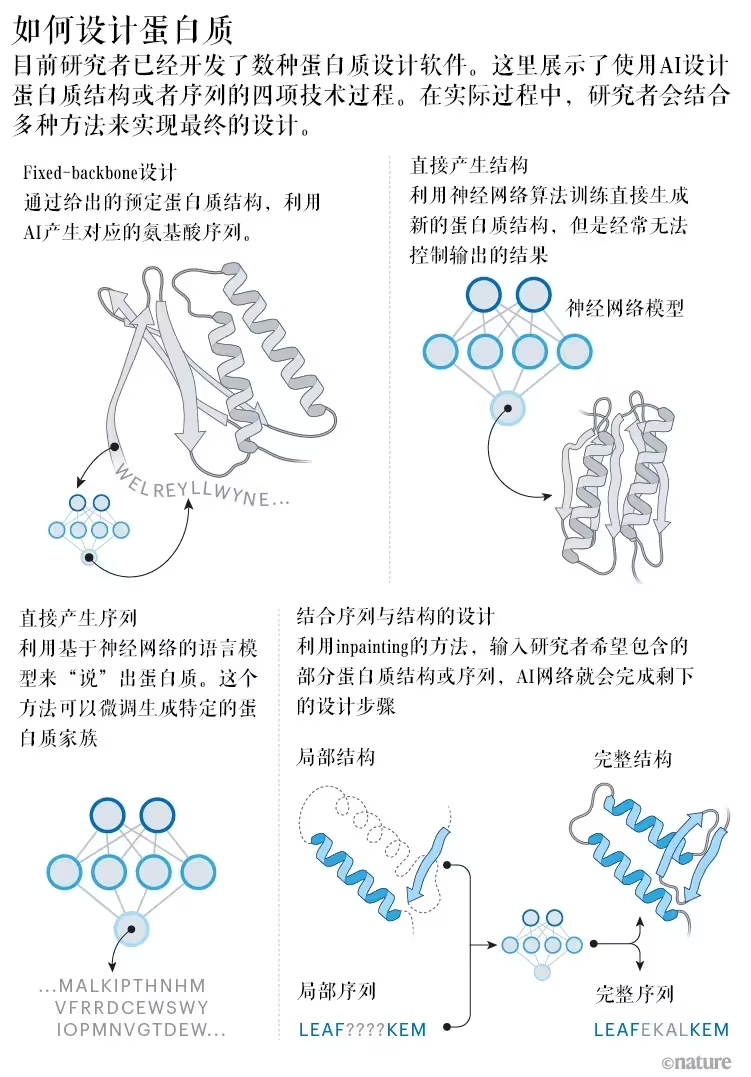

这其实是一个和蛋白质结构预测刚好相反的问题:蛋白质结构预测是从序列到结构,而创造蛋白质是要求从我们希望得到的结构,反推出合适的蛋白质序列。过去这是个计算量巨大的工作,现在AI也能完成了。

四种目前常用的设计蛋白质策略 | 图片翻译自:Nature

相比于大批量预测蛋白质结构,创造蛋白质的目的就更加明确——我们希望能创造出自然界不存在,但是对人类非常有用的蛋白质。

实际上,目前大部分尝试设计都很精彩,但是实验验证阶段就不那么顺利了——AI设计出来的蛋白质结构,往往不能像预期的那样被正确表达、合成出来。

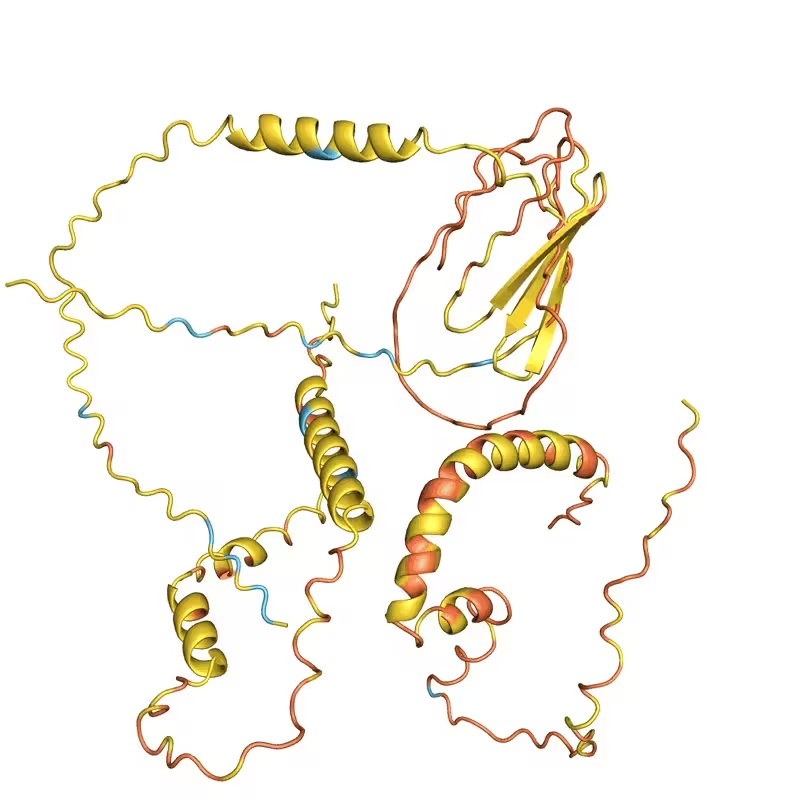

不过设计蛋白质的尝试还在不断进步和迭代,可能在不远的将来就能够出现在我们的日常生活里。例如最新的研究中,利用ProteinMPNN和RoseTTAFold方法设计出来的蛋白质,不仅在自然界完全不存在,并且大大提高了这些蛋白质结构的稳定性,预计在未来会被用作疾病治疗的抗原抗体,或者生物化学反应所需的生物酶。

蛋白质设计的过程,通过不断改变序列让蛋白质结构趋于稳定(结构的稳定基于AlphaFold预测,越红代表越不稳定,越蓝代表越稳定) | 图源:Nature

AI会取代我们的大脑吗?

在生命科学研究中,还有一个难以攻克的问题:如何解读意识?我们的大脑有数十亿个神经元,它们组成的网络连接错综复杂,现有的神经科学研究虽然成果累累,但是仍然不知道人类是怎么思考的。

那,AI可以做到吗?

也许马上就可以了。

功能核磁共振技术(fMRI)可以检测到当我们在做某件事情时大脑血流的变化,来寻找被激活的大脑区域,在过去十几年也被用于研究大脑各个脑区的具体功能。

这是fMRI的图像,通过和静息状态的对比,研究者可以找到被激活的脑区(红色标记) | 图源网络

随着AI的发展,研究者近几年开始了“逆向”推导:既然我们可以检测到大脑的激活状态,那么,是不是就可以通过激活状态,来反向推出人在想什么呢?比如,可以复原出人类看到的东西?

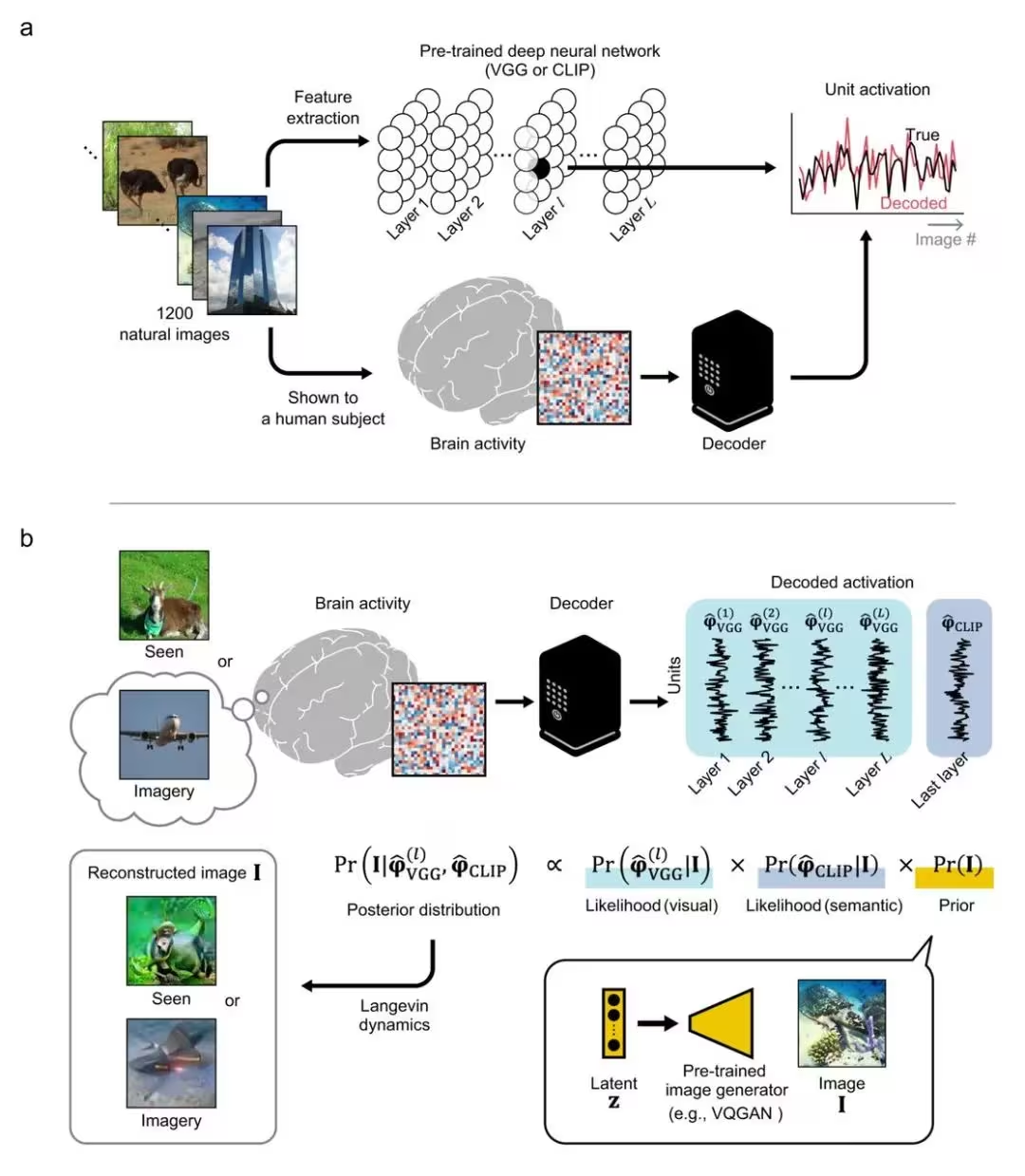

于是研究者首先给志愿者看了成千上万张不同的图片,并测量、记录他们脑区的激活状态,作为AI的训练集。之后再利用训练出来的模型,来检测AI推测人看到的、或者想象的图片的能力。

实验设计的流程,上图为利用大量图片构建训练集,构建深度神经网络模型;下图则是基于模型,解析大脑信号产生的意识图像 | 图源:Koide-Majima N, 2023.

结果其实不算特别理想。因为fMRI数据比较少,无法构建足够大的训练集,虽然AI能形成一定的轮廓,但是也仅限于给出大概的形状。

但是,如果给AI一点小小的文字提示辅助,它就能快速形成和真实图像高度相似的结果!

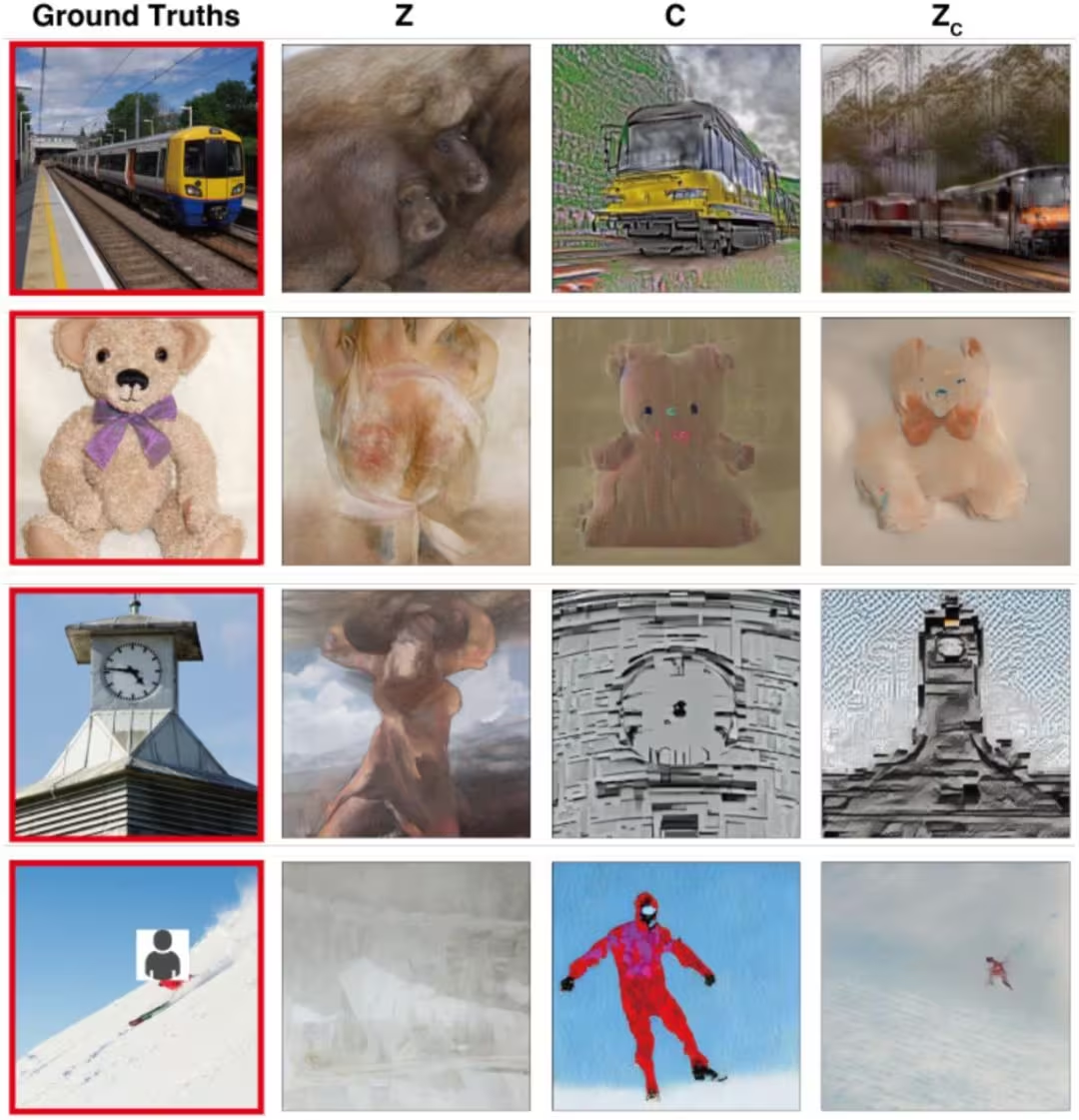

第一列是志愿者看到的图片,第二列(z)是单纯基于大脑活动检测AI生成的图片,第三列(c)是单纯基于文字信息AI做的图片,第四列则是基于二三列的信息共同生成的结果,已经依稀可以分辨出原来图片的样子 | 图源:Takagi Y, 2023.

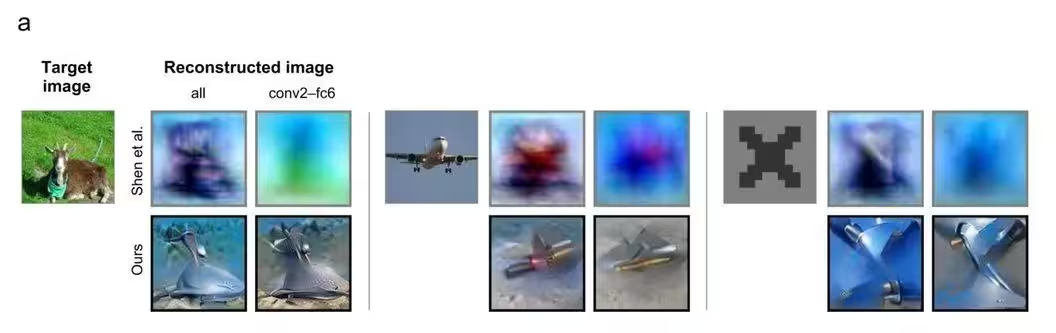

第一行为真实照片,第二行则为AI基于大脑活动和文字提示形成的图像 | 图源:Takagi Y, 2023.

当然,这些研究的目的不是为了让AI理解人类,而是希望通过AI分析的过程,更好地理解大脑运作的方式——比如研究者们计划利用这套模型,在未来检测动物的大脑活动,来看看动物们眼中的世界会是什么样子的。

除此以外,研究者还尝试让志愿者想象一个画面,再让AI基于大脑活动来生成图像。虽然得到的图像更加抽象了,但是研究者认为这对于未来的心理学研究有很重要的意义。

三组图像基于想象的脑活动预测的结果,第一行为2019年的研究,第二行为2023年的研究,可以看到算法的提升 | 图源:Koide-Majima N, 2023.

发表回复